Hasta hace poco, el fraude telefónico era relativamente fácil de detectar. Un acento extraño o una voz que no encajaba solían ser suficientes para colgar. Pero en este 2026, las estafas de vishing por IA han dado un salto de gigante. Nuestros oídos ya no son un filtro de seguridad fiable. En este artículo sobre ciberseguridad, desgranamos cómo la clonación de voz por Inteligencia Artificial está creando la trampa perfecta.

¿Qué es el Vishing y por qué es más peligroso ahora?

El vishing (voice phishing) ha evolucionado. Ya no hablamos de simples llamadas de spam, sino de ataques de ingeniería social donde la tecnología de deep learning permite clonar una voz humana con una precisión asombrosa usando muestras de audio de apenas 30 segundos.

La Tecnología: Tu voz en manos de cualquiera :

¿De dónde sacan el audio los estafadores? De cualquier lugar público: un vídeo de Instagram, un TikTok o incluso un mensaje de voz reenviado. Una vez que la IA aprende el timbre y la entonación de la víctima, el atacante solo tiene que escribir el mensaje y la máquina lo reproducirá fielmente. Si a esto le sumamos el spoofing (suplantar el número de teléfono para que parezca que llama «Mamá» o «Jefe»), el engaño es casi total.

La evolución de la IA: De los chats de texto a la clonación de voz

Es asombroso ver lo rápido que ha avanzado esta tecnología. No hace tanto tiempo, nos sorprendíamos con las capacidades de respuesta de los primeros modelos de lenguaje. Como ya analizamos en nuestro artículo sobre qué es ChatGPT y cómo funciona la inteligencia artificial, el foco estaba puesto en la generación de texto y la asistencia básica.

Sin embargo, en apenas un par de años, hemos pasado de «chatear» con una IA a ver cómo estas herramientas pueden replicar la identidad biométrica de una persona (su voz) con una fidelidad aterradora. Esta evolución obliga a que tanto usuarios como empresas busquen asesoramiento especializado en software informático para actualizar sus protocolos de seguridad, ya que las defensas de 2023 o 2024 se han quedado obsoletas ante el vishing de 2026.

Los Dos Guiones Principales del Fraude telefónico con IA :

1. La Urgencia Familiar: Una llamada desde un número desconocido pero con la voz idéntica de un hijo o pareja. Alegan una emergencia (accidente o detención) para solicitar dinero inmediato. El miedo es su mejor arma.

2. El «Fraude del CEO» 2.0: Dirigido a empresas. Un empleado recibe instrucciones de su «jefe» por voz para realizar una transferencia confidencial urgente. La familiaridad de la voz reduce cualquier sospecha. Ante esta amenaza, es vital contar con protocolos de desarrollo de software seguros que incluyan sistemas de verificación multifactor para evitar brechas de seguridad interna.

El impacto económico del Vishing en las empresas

El vishing sintético no es solo una molestia digital; es una amenaza financiera real. En 2025, las pérdidas globales por ataques de suplantación de identidad mediante IA superaron cifras récord, afectando especialmente a pequeñas y medianas empresas que no cuentan con protocolos de doble verificación.

El coste de un ataque de vishing exitoso para una empresa incluye:

- Pérdida directa de capital: Transferencias urgentes que terminan en cuentas internacionales imposibles de rastrear.

- Daño reputacional: La pérdida de confianza de los clientes al saber que los sistemas de comunicación interna han sido vulnerados.

- Costes de recuperación: Auditorías de seguridad de urgencia para comprobar qué otros datos han podido ser comprometidos.

El éxito de estos ataques no solo reside en la tecnología, sino en la falta de protocolos. Por ello, en software informático nos enfocamos en que cada proyecto no solo cumpla con estándares de SEO y visibilidad, sino que sea ante todo una plataforma robusta frente a la ingeniería social. La seguridad debe ser el cimiento de cualquier presencia digital moderna.

Protocolos de prevención: Cómo detectar el deepfake de voz

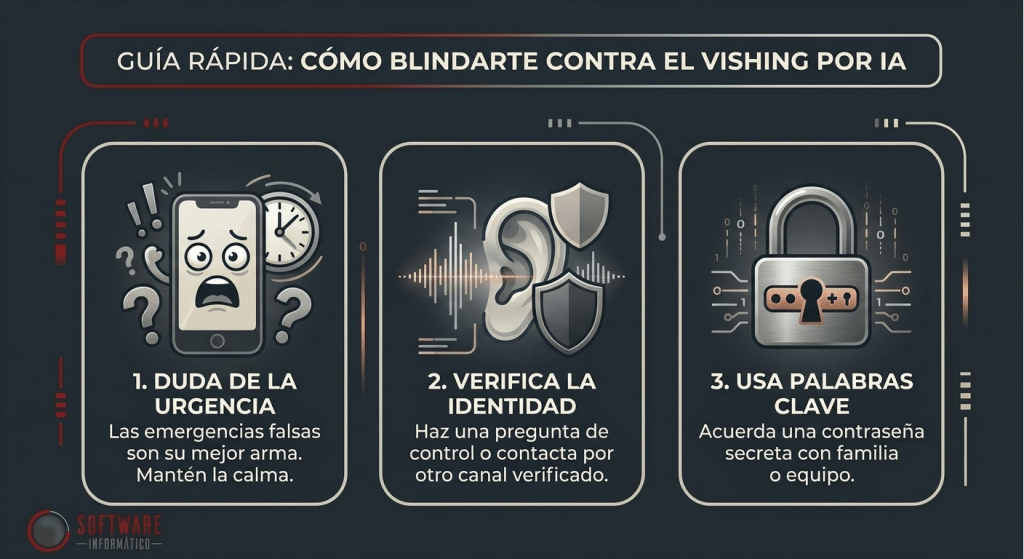

Afortunadamente, nosotros podemos ser más listos que la tecnología. Para mejorar tu seguridad informática, aplica estas pautas esenciales:

- Contraste por otra vía: Ante una solicitud de dinero, cuelga. Llama tú al número de siempre o contacta por otra app para verificar la historia.

- Busca las «costuras» de la IA: Presta atención a pausas poco naturales o errores de entonación extraños. Mantén la calma para detectar estas anomalías.

- La «Palabra de Seguridad»: Acuerda una contraseña secreta con tu familia o equipo de trabajo. Si no la saben decir, es un fraude seguro.